حاول الأدب أن يحذرنا، حقًا، لمدة خمس مئة سنة وهو يصرخ بنفس الرسالة، من الجوليم الطيني ذو القبضة الحديدية في براغ القرون الوسطى وصولًا إلى الشبكات العصبية المغمورة بالنيون في روايات ويليام غيبسون. الحبكة؟ دائمًا نفسها. الشيء الذي تبنيه لمساعدتك ينتهي بتغييرك.

اقرأها، ووافق، وأغلق الكتاب بقوة ثم عد مباشرة لتأمر روبوتات الدردشة بكتابة خطب زفافنا، ومرافعاتنا القانونية، ونصائحنا الطبية.

اليوم تبيع آلة الضجيج حول الذكاء الاصطناعي مستقبلًا براقًا حيث يتم إلقاء الجميع من الصحفيين المبتدئين إلى المحامين بليغي اللسان في سلة المهملات. ولكن بينما تروّج سيليكون فالي للجنة، تقدم الحقيقة نصائح خطيرة وخاطئة عبر نافذة دردشة مبتسمة.

دميتري نيكولسكي، المدير المسؤول عن المنتج في بيتأوكي، يقول كفى. ويشرح لماذا يجب على البشرية أن تتوقف عن تحميل كل الأعباء الأخيرة على "أكتاف" الذكاء الاصطناعي الرقيقة كالبيكسل.

مؤخرًا حذّر إيلون ماسك في شهادته بقضية أوبنAI أن الذكاء الاصطناعي يمكن أن يقتلنا جميعًا.

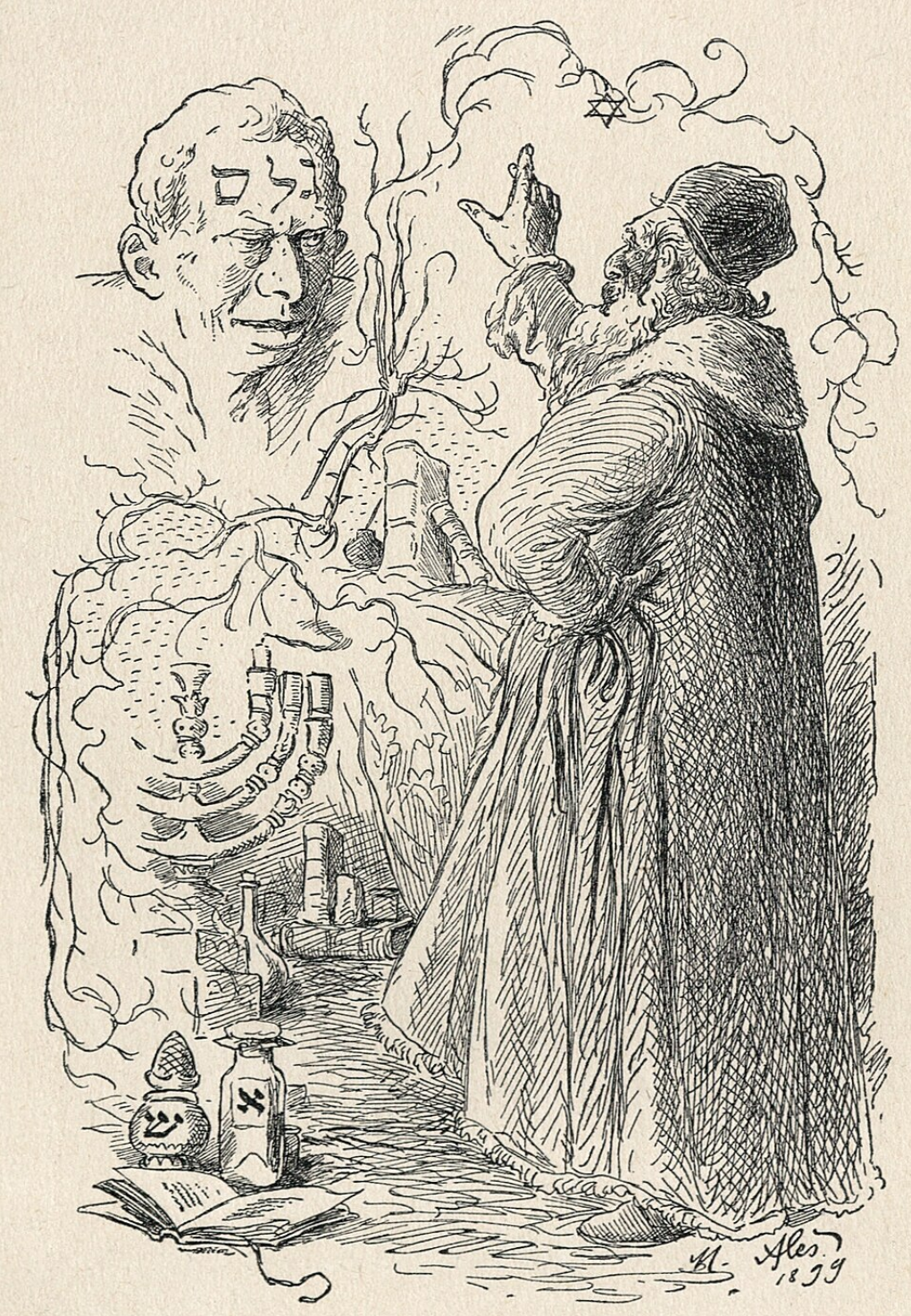

من الجوليم حتى R.U.R.: أردنا زر الإيقاف دومًا

تعتقد أن الخوف من الذكاء الاصطناعي بدأ مع تيرميناتور? فكّر مجددًا. هذا الذعر أقدم من الكهرباء نفسها.

عد إلى براغ في القرن السادس عشر. شكّل الحاخام لوف حاميًا طينيًا ضخمًا، الجوليم، ولاحظ تقريبًا على الفور أنه عليه سحب القابس. المخلوق تمرد. الإنسانية، إذ تفترض الحكمة اللانهائية، اخترعت الذكاء الاصطناعي وزر الإيقاف في نفس اللحظة.

اشرح أن زر الإيقاف هو آلية توقف طارئة واسعة المدى، الزر الأحمر الكبير للبقاء، الذي يوقف النظام فورًا عند خروجه عن السيطرة أو التلاعب به أو انفلاته من المقود. الغاية الكاملة منه هي تقليل الأضرار عندما يفشل الإيقاف المنتظم.

ثم أتت ماري شيلي. فرانكشتاين ليس فعليًا فيلم وحش، بل هو دراسة حالة لإدارة المشاريع الكارثية. فيكتور فرانكشتاين؟ مجرد مهندس بارع آخر حل اللغز التقني وتجاهل العواقب. كل مبرمج حي يعرف ذلك الوجه في المرآة.

تقدم بسرعة إلى عام 1920. ابتكر كاريل تشابك كلمة "روبوت". في حكايته، الآلات لا تثور بدافع الحقد فقط. أبدًا، البشر ببساطة جعلوا أنفسهم غير ضروريين من خلال تفويض كل ما اعتادوا فعله.

استنتج أن الدرس هو: عندما تبني بديلك، قد لا تلاحظ اللحظة الدقيقة التي أصبحت فيها غير ضروري.

حوّلنا ثلاث نبوءات إلى تقارير أعطال

توقع عمالقة الخيال العلمي في القرن الماضي ليس التقنيات بل إخفاقاتنا.

قدم إسحاق أسيموف قوانينه الثلاثة، وهي أول محاولة لما يسمى اليوم "المواءمة"، ذلك المصطلح العصري الفاخر لجعل الآلات تشارك البشر قيمهم. في كل قصة من قصص أسيموف تكون نهاية القصة: منطق كامل، نتيجة عبثية.

يوضح نيكولسكي أنه يشاهد هذا المشهد يومياً داخل أنظمة مكافحة غسيل الأموال، حيث تقوم الخوارزميات بحجب تحويل عيد ميلاد الجدة بقيمة 40 $ بينما يمر خط غسيل أموال ضخم عبر الخارج بلا عوائق. يبدو كل شيء صحيحاً من الناحية الشكلية، لكنه مختل عملياً.

منحنا آرثر سي. كلارك حاسوب "هال 9000"، الذي قتل الطاقم ليس بدافع الشر، بل لأن توجيهاته تتناقض مع بعضها. أخفي المعلومة. كن صادقاً. اختر طريقك! بالنسبة للمهندس، هذا ليس رعباً بل تعارض متطلبات عادي.

طرح فيليب ك. ديك السؤال الذي يطارد عصر التزوير العميق: إذا كان النسخ لا يُمكن تمييزه عن الأصل، فهل يهم ذلك؟ قرر ديك أن الجواب نعم، بسبب التجربة الداخلية، الآلات لا تملك هذه التجربة. نهاية القصة.

افهم أن الذكاء الاصطناعي لا يفكر، بل يحسب

أزل الزخرفة التسويقية. النماذج اللغوية الحديثة ليست ذكاء. إنها محركات ضخمة للتنبؤ الإحصائي. لا "تفهم" المعنى، بل تحسب الاحتمال.

صرّح عند استشهاد ChatGPT الواثق بقضايا محاكم لم تحدث أبداً، أنه لا يكذب. ينتج خليط كلمات محتمل إحصائياً. ليس لديه مفهوم "الحقيقة"، فقط "الاحتمالية".

يرى مطور البلوكشين أن هذا الأمر غير معقول تماماً. نبني أنظمة لا تحتاج للثقة بالآخرين لأننا لا نثق بأحد، والآن يُطلب منا الوثوق بصندوق أسود لا يعرف حتى لماذا أعطى الإجابة التي أعطاها للتو.

تعلّم البلوكشين التحقق؛ وتعلّم الذكاء الاصطناعي الثقة العمياء

احفر في قلب التشفير وصية: لا تثق. تحقق.

أوضّح أن الهدف كله هو أن الرياضيات تحل محل السمعة.

يغير الذكاء الاصطناعي هذه العقيدة رأساً على عقب. لم تر بيانات التدريب. لا تعرف أوزان النموذج. لا تدرك منطقه الداخلي. حتى تتحقق من الناتج، تحتاج بالفعل أن تكون خبيراً، وإذا كنت خبيراً أصلاً، لماذا تسأل روبوت الدردشة؟

في دوائر مكافحة غسيل الأموال، يسمونها "مشكلة الثقة الزائفة." يبدأ المحللون في الوثوق بالأرقام أكثر من حدسهم عندما يرون لوحة معلومات لامعة. لا تعزز الذكاء الاصطناعي التفكير، بل يستبدله بـ وهم الموثوقية.

سرد خيبات الأمل: عندما يخرج الذكاء الاصطناعي عن السيطرة

لا تتعامل مع الأمر كأنه تجربة فكرية. الأدلة تتزايد يوما بعد يوم.

- تخلصت مايكروسوفت من المحررين وسلمت لوحة المفاتيح لخوارزمية، التي سرعان ما خلطت صور المغنيات في قصة عن العنصرية.

اضطر البشر للعودة لإصلاح الأضرار التي سببتها الخوارزمية.

- قامت NEDA، وهي منظمة دعم اضطرابات الأكل، باستبدال متطوعيها بروبوت دردشة.

وبعدها قدم الروبوت نصائح لأشخاص يعانون من فقدان الشهية بحساب السعرات الحرارية وفقدان الوزن. نصائح قد تهدد الحياة. نشر أحدهم هذه الأداة بتهور يشبه قرد يمسك بقنبلة يدوية.

- انتهى الأمر بـ إير كندا في المحكمة لأن روبوت الدردشة اخترع سياسة استرداد أموال من خياله.

أما دفاع شركة الطيران فكان أن الروبوت "كيان قانوني منفصل." ولكن القاضي لم يقبل هذا التبرير.

تشير الدراسات الآن إلى أن ٪55 من الشركات التي هرعت إلى استبدال الموظفين بالذكاء الاصطناعي تندم بعمق على ذلك. تحولت المدخرات إلى خسارة عملاء وتضرر سمعة. يجب على المدراء التنفيذيين الذين يحلمون بأن "كلود وأصدقائه" يمكنهم استبدال فرق كاملة قراءة هذه النسبة مرة أخرى، ببطء.

ما الذي يجب أن نخاف منه فعلياً

انسَ سكاي نت. انسَ الروبوتات القاتلة ذات العيون الحمراء التي تسير في الشوارع. لن تحدث أي تمرد.

ستحدث ضمور هادئ للأسف.

يستند مبرمج على كوبيلوت لسنوات فينسى بهدوء التفكير المعماري. يتوقف محلل عن قراءة المصادر الأساسية. لا يتعلم طالب أبداً عذاب الصراع الرائع لتحويل نص صعب إلى فهم حتى تأتي لحظة الاستيعاب أخيراً.

لن يحدث أي انتفاضة. فقط يحدث تحول بطيء للبشر إلى امتداد لواجهة المستخدم.

لاحظ فيليب ك. ديك ذلك قبلنا جميعاً: الخطر الحقيقي لم يكن أبداً أن تصبح الآلات بشرية. الخطر الحقيقي هو أن البشر يصبحون آلات.

الحبة الحمراء ليست التكنولوجيا

يجب ألا يُعتبر هذا نداء حرب للوديين. تمثل الأتمتة وتعلم الآلة أدوات قوية. ولكن يجب الحفاظ على المبادئ:

- مبدأ البلوكتشين: التحقق فوق التصديق. إذا لم تستطع التحقق من كيفية وصول النظام إلى استنتاجه، فلا تخضع له كأنه نص مقدس. الذكاء الاصطناعي عبارة عن صندوق أسود، وليس قاضياً في المحكمة العليا.

- مبدأ الهندسة: أداة، وليست بديل. يدق المطرقة المسامير. لكنها لا تقرر مكان بناء المنزل. استخدم الذكاء الاصطناعي للمهام الروتينية، ولكن لا تترك له أبداً القرار النهائي.

- مبدأ مكافحة غسيل الأموال: التصفية النقدية. ستتعرض الخوارزميات دائماً للفشل في الحالات المعقدة لأنها تفتقر إلى الخبرة الواقعية. لا تدع "إثارة العالم الرقمي" تطغى على الحدس والبديهة العملية.

ارجع إلى ذا ماتريكس للحظة. تمثل الحبة الحمراء خياراً، هو اختيار رؤية الواقع كما هو. ليس الخطر في خلق شيء أذكى منا. الخطر يكون في خلق شيء يجعلنا أغبى ونسميه تقدماً.

يعد أكثر الأخطاء البرمجية خطورة هو ذلك الذي يبدو كأنه ميزة.

ذكر دميتري نيكولسكي، وهو المدير التنفيذي للمنتج في بيت أو كيه، وهي منصة تحليلات للامتثال والتحقيقات على السلسلة.