يشير تزايد الاستثمار في وكلاء الذكاء الاصطناعي إلى مستقبل من الأتمتة الواسعة الانتشار، قد يكون أكثر تحولًا من الثورة الصناعية. كما هو الحال مع أي ابتكار تكنولوجي، من المؤكد أن وكلاء الذكاء الاصطناعي سيواجهون مشاكل في تطويرهم. سيكون التحسين المستمر ضروريًا للاستخدام المسؤول وتحقيق الإمكانات الكاملة لوكلاء الذكاء الاصطناعي.

في مؤتمر كونسينسوس هونغ كونغ، أجرت BeInCrypto مقابلة مع أندريه غراتشيف، الشريك الإداري في DWF Labs، حول التحديات الرئيسية التي تواجه وكلاء الذكاء الاصطناعي في تحقيق التبني الجماعي وكيف قد يبدو الاستخدام الواسع النطاق.

القطاعات التقنية التقليدية وWeb3 تتبنى الذكاء الاصطناعي

في هذه المرحلة، يمكن القول بأمان أن تبني الذكاء الاصطناعي (AI) سيصبح قريبًا أمرًا لا مفر منه. أعلنت عمالقة التكنولوجيا بما في ذلك ميتا، أمازون، ألفابت، وميكروسوفت بالفعل عن خطط لاستثمار ما يصل إلى 320 مليار دولار في الذكاء الاصطناعي ومراكز البيانات في 2025.

خلال الأسبوع الأول من توليه المنصب، أعلن الرئيس الأمريكي ترامب عن ستارغيت، مشروع مشترك خاص جديد يركز على تطوير مراكز بيانات الذكاء الاصطناعي. يخطط المشروع، المكون من أوبن إيه آي، سوفتبانك، وأوراكل، لبناء ما يصل إلى 20 مركز بيانات كبير للذكاء الاصطناعي في جميع أنحاء الولايات المتحدة.

تقدر الاستثمارات الأولية بحوالي 100 مليار دولار، وقد تصل خطط التوسع إلى 500 مليار دولار بحلول 2029.

تقوم مشاريع ويب3 أيضًا باستثمارات مماثلة في الذكاء الاصطناعي. في ديسمبر، أطلقت DWF Labs، وهي شركة رائدة في رأس المال الاستثماري للعملات المشفرة، صندوقًا بقيمة 20 مليون دولار لوكلاء الذكاء الاصطناعي لتسريع الابتكار في تقنيات الذكاء الاصطناعي المستقلة.

في وقت سابق من هذا الشهر، أعلنت مؤسسة NEAR، التي تدعم بروتوكول NEAR، أيضًا عن صندوقها الخاص بقيمة 20 مليون دولار يركز على توسيع تطوير الوكلاء المستقلين والقابلين للتحقق المبنيين على تكنولوجيا NEAR.

قال غراتشيف لـ BeInCrypto: "تظهر التاريخ أن كل ما يمكن أتمتته سيتم أتمتته، وبالتأكيد سيتم تجاوز بعض عمليات الأعمال والحياة العادية بواسطة وكلاء الذكاء الاصطناعي".

لكن مع تسارع تطوير الذكاء الاصطناعي، يصبح احتمال إساءة استخدامه مصدر قلق متزايد.

الاستخدام الضار لوكلاء الذكاء الاصطناعي

في ويب3، وكلاء الذكاء الاصطناعي أصبحوا بالفعل سريعًا جزءًا من التيار الرئيسي. يقدمون قدرات متنوعة، من تحليل السوق إلى التداول المستقل للعملات المشفرة.

ومع ذلك، فإن دمجهم المتزايد يقدم أيضًا تحديات حاسمة. إساءة استخدام الذكاء الاصطناعي من قبل الجهات الخبيثة هو مصدر قلق كبير، يشمل سيناريوهات تتراوح من حملات التصيد البسيطة إلى هجمات الفدية المعقدة.

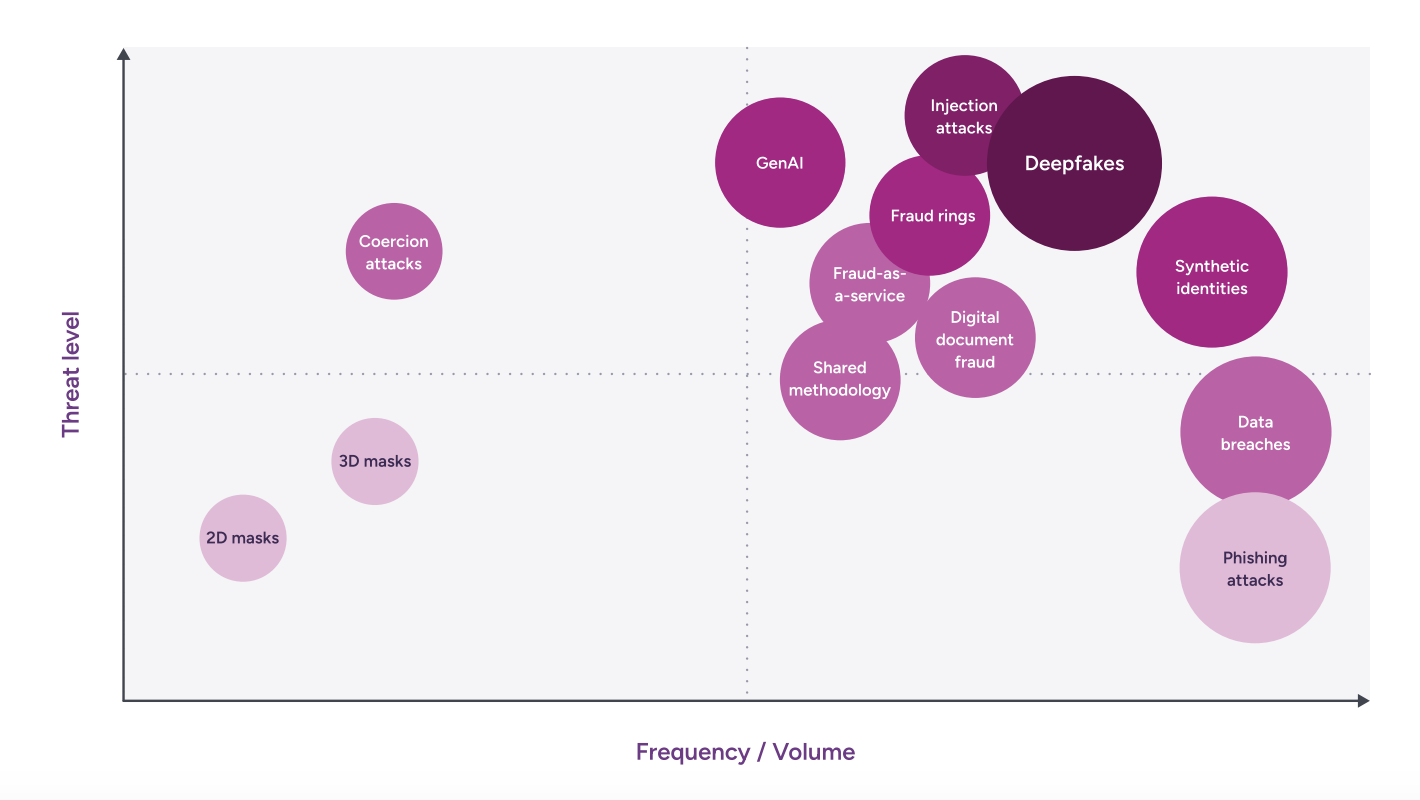

لقد غير التوافر الواسع للذكاء الاصطناعي التوليدي منذ أواخر 2022 بشكل جذري إنشاء المحتوى بينما جذب أيضًا الجهات الخبيثة التي تسعى لاستغلال التكنولوجيا. لقد عززت هذه الديمقراطية في قوة الحوسبة قدرات الخصوم وقد تكون خفضت الحاجز أمام الدخول للجهات التهديدية الأقل تطورًا.

وفقًا لتقرير من Entrust، فإن التزوير الرقمي للوثائق الذي يسهل بواسطة أدوات الذكاء الاصطناعي يفوق الآن التزوير المادي، مع زيادة بنسبة 244٪ على أساس سنوي في 2024. وفي الوقت نفسه، شكلت التزييفات العميقة 40٪ من جميع الاحتيالات البيومترية.

“يتم استخدامها بالفعل في عمليات الاحتيال. تُستخدم في مكالمات الفيديو عند تمثيل الأشخاص وتمثيل أصواتهم”، قال غراتشيف.

أمثلة على هذا النوع من الاستغلال قد ظهرت بالفعل في عناوين الأخبار. في وقت سابق من هذا الشهر، تم خداع موظف مالي في شركة متعددة الجنسيات في هونغ كونغ للموافقة على دفع 25 مليون دولار إلى المحتالين باستخدام تقنية التزييف العميق.

حضر الموظف مكالمة فيديو مع أفراد اعتقد أنهم زملاء، بما في ذلك المدير المالي للشركة. على الرغم من التردد الأولي، استمر الموظف في الدفع بعد أن ظهر المشاركون الآخرون وبدوا أصليين، وفقًا للتقارير. تم اكتشاف لاحقًا أن جميع الحاضرين كانوا تزييفات عميقة.

من التبني المبكر إلى القبول السائد

يعتقد غراتشيف أن مثل هذه الاستخدامات الخبيثة لا مفر منها. يشير إلى أن التطور التكنولوجي غالبًا ما يكون مصحوبًا بأخطاء أولية، والتي تقل مع نضوج التكنولوجيا. قدم غراتشيف مثالين مميزين لإثبات وجهة نظره: المراحل الأولى من الشبكة العالمية وبيتكوين.

“يجب أن نتذكر أن الإنترنت بدأ من مواقع الإباحية. كان مثل بيتكوين الأول، الذي بدأ من تجار المخدرات ثم تحسن”، قال.

عدة تقارير تتفق مع غراتشيف. تشير إلى أن صناعة الترفيه للبالغين لعبت دورًا حاسمًا في التبني المبكر وتطوير الإنترنت. بالإضافة إلى توفير قاعدة مستهلكين، كانت رائدة في تقنيات مثل أجهزة الفيديو، البث الفيديو، الواقع الافتراضي، وأي شكل من أشكال التواصل.

عملت الإباحية كأداة إدخال. تاريخيًا، قادت صناعة الترفيه للبالغين تبني المستهلكين للتقنيات الجديدة.

تبنيها المبكر وتطبيقها للابتكارات، خاصة عندما تلبي بنجاح احتياجات جمهورها، غالبًا ما يؤدي إلى تبني أوسع في التيار الرئيسي.

“بدأت بالمرح، لكن المرح أدخل الكثير من الناس. ثم يمكنك بناء شيء على هذا الجمهور”، قال غراتشيف.

مع مرور الوقت، تم وضع تدابير وقائية للحد من تكرار وإمكانية الوصول إلى الترفيه للبالغين. ومع ذلك، لا يزال واحدًا من العديد من الخدمات التي يوفرها الإنترنت اليوم.

رحلة البيتكوين من الشبكة المظلمة إلى الاضطراب

تطور بيتكوين يعكس بشكل وثيق الاستخدامات الأولى للإنترنت. كان التبني المبكر لبيتكوين مرتبطًا بشكل كبير بأسواق الشبكة المظلمة والأنشطة غير القانونية، بما في ذلك تهريب المخدرات والاحتيال وغسل الأموال. جعلت طبيعته المستعارة وسهولة تحويل الأموال العالمية منه جذابًا للمجرمين.

على الرغم من استخدامه المستمر في الأنشطة الإجرامية، فقد وجد بيتكوين العديد من التطبيقات الشرعية. توفر تقنية البلوكشين التي تدعم العملات المشفرة حلولًا للمشاكل الواقعية وتحدث ثورة في الأنظمة المالية التقليدية.

على الرغم من أنها لا تزال صناعات ناشئة جدًا، ستستمر تطبيقات العملات المشفرة والبلوكشين في التطور. وفقًا لغارشف، سيحدث نفس الشيء مع التوظيف التدريجي لتقنية الذكاء الاصطناعي. بالنسبة له، يجب الترحيب بالأخطاء للتعلم منها والتكيف وفقًا لذلك.

“يجب أن نتذكر دائمًا أن الاحتيال يحدث أولاً ثم يبدأ الناس في التفكير في كيفية منعه. بالطبع سيحدث، لكنه عملية طبيعية، إنها منحنى تعليمي”، قال غراشيف.

ومع ذلك، فإن معرفة أن هذه المواقف ستحدث في المستقبل يثير أيضًا تساؤلات حول من يجب أن يتحمل المسؤولية.

مخاوف المسؤولية

تحديد المسؤولية عندما يحدث ضرر بسبب أفعال وكيل هو قضية قانونية وأخلاقية معقدة. يثار السؤال حول كيفية تحميل الذكاء الاصطناعي المسؤولية بشكل حتمي.

تعقيد أنظمة الذكاء الاصطناعي يخلق تحديات في تحديد المسؤولية عن الأضرار. طبيعتها "الصندوق الأسود"، السلوك غير المتوقع، وقدرات التعلم المستمر تجعل من الصعب تطبيق الأفكار التقليدية حول من هو المسؤول عندما يحدث خطأ ما.

علاوة على ذلك، فإن مشاركة أطراف متعددة في تطوير ونشر الذكاء الاصطناعي تعقد تقييمات المسؤولية، مما يجعل من الصعب تحديد مسؤولية فشل الذكاء الاصطناعي.

قد تقع المسؤولية على عاتق الشركة المصنعة بسبب عيوب التصميم أو الإنتاج، أو مطور البرمجيات بسبب مشاكل في الكود، أو المستخدم لعدم اتباع التعليمات، أو تثبيت التحديثات، أو الحفاظ على الأمان.

“أعتقد أن كل هذا جديد جدًا، وأعتقد أنه يجب أن نكون قادرين على التعلم منه. يجب أن نكون قادرين على إيقاف بعض وكلاء الذكاء الاصطناعي إذا لزم الأمر. ولكن من وجهة نظري، إذا لم يكن هناك نية سيئة لصنعه، فلا أحد مسؤول عنه لأنك تتعامل مع شيء جديد حقًا”، قال غراشيف لـ BeInCrypto.

ومع ذلك، وفقًا له، يجب إدارة هذه المواقف بعناية لتجنب التأثير على الابتكار المستمر.

“إذا ألقيت اللوم على هذا رائد الأعمال، فسوف تقتل الابتكارات لأن الناس سيخافون. ولكن إذا عملت بطريقة سيئة، صحيح، فقد تعمل في النهاية. نحن بحاجة إلى طريقة لإيقافها، التعلم، التحسين، وإعادة التعلم”، أضاف غراتشيف.

ومع ذلك، يبقى الخط الفاصل رفيعًا للغاية، خاصة في السيناريوهات الأكثر تطرفًا.

معالجة قضايا الثقة لاعتماد الذكاء الاصطناعي المسؤول

الخوف الشائع عند مناقشة مستقبل الذكاء الاصطناعي يتعلق بالمواقف التي يصبح فيها وكلاء الذكاء الاصطناعي أكثر قوة من البشر.

“هناك الكثير من الأفلام حول هذا الموضوع. إذا كنا نتحدث عن، لنقل، الشرطة أو سيطرة الحكومة، أو بعض الجيوش في نوع من الحروب، بالطبع الأتمتة مثل الخوف الكبير. يمكن أن يتم أتمتة بعض الأشياء إلى مستوى كبير حيث يمكن أن تؤذي البشر”، قال غراتشيف.

عندما سئل عما إذا كان يمكن أن يحدث سيناريو كهذا، قال غراتشيف إنه، من الناحية النظرية، يمكن أن يحدث. ومع ذلك، اعترف بأنه لا يمكنه معرفة ما سيحدث في المستقبل.

ومع ذلك، فإن مثل هذه المواقف تمثل قضايا الثقة الأساسية بين البشر والذكاء الاصطناعي. يقول غراتشيف إن أفضل طريقة للتعامل مع هذه المشكلة هي تعريض البشر لحالات استخدام حيث يمكن أن يكون الذكاء الاصطناعي مفيدًا بالفعل.

“يمكن أن يكون الذكاء الاصطناعي صعبًا على الناس لتصديقه. لهذا السبب يجب أن يبدأ بشيء بسيط، لأن الثقة في وكيل الذكاء الاصطناعي لن تُبنى عندما يشرح شخص ما أنه موثوق به. يجب أن يعتاد الناس على استخدامه. على سبيل المثال، إذا كنت تتحدث عن العملات المشفرة، يمكنك إطلاق ميم، لنقل على Pump.fun، ولكن لماذا لا تطلقه برسالة صوتية؟ مع وكلاء الذكاء الاصطناعي، فقط أرسل رسالة صوتية تقول ‘يرجى إطلاق هذا وذاك’، ويتم إطلاقه. ثم الخطوة التالية [ستكون] الثقة في الوكيل ببعض القرارات الأكثر أهمية”، قال.

في النهاية، ستكون الرحلة نحو اعتماد الذكاء الاصطناعي على نطاق واسع بلا شك مليئة بالتقدم الملحوظ والتحديات غير المتوقعة.

سيكون التوازن بين الابتكار والتنفيذ المسؤول في هذا القطاع المتطور حاسمًا لتشكيل مستقبل يستفيد فيه الذكاء الاصطناعي جميع البشرية.